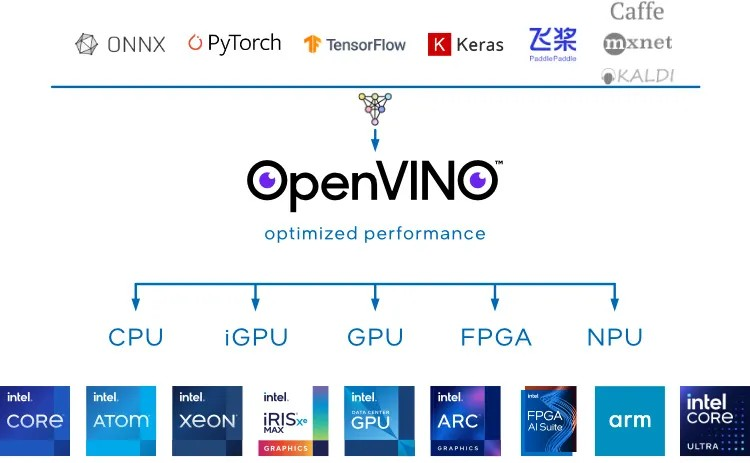

英特尔的开源OpenVINO AI工具包发布了2026年的首个重大版本。随着今日OpenVINO 2026.0版本的发布,增加了对大型语言模型(LLM)的扩展支持,改进了英特尔NPU对Core Ultra系统的支持,并为英特尔CPU/NPU/GPU系列产品在AI方面的应用带来了多种其他增强功能。

OpenVINO 2026.0版本增加了对GPT-OSS-20B、MiniCPM-V-4_5-8B和MiniCPM-o-2.6模型的CPU和GPU执行支持。有点令人惊讶的是,他们直到现在才正式支持OpenAI的GPT-OSS-20B,但无论如何,现在OpenVINO 2026.0版本已经支持了该模型。

对于具有较小模型的 NPU,现在也支持 MiniCPM-o-2.6、Qwen2.5-1B-Instruct、Qwen3-Embedding-0.6B 和 Qwen-2.5-coder-0.5B。

OpenVINO GenAI 同时增加了对单词级时间戳的支持,以增强功能,实现更准确的转录和字幕,从而更好地与 OpenAI 和 FasterWhisper 实现相结合。OpenVINO 2026.0 还支持 int4 数据感知权重压缩,用于 3D MatMuls,以使 MoE LLMs 在更低的内存/带宽需求下运行,并提高准确性。现在还支持 VLM 管道,以增强 Agentic AI 框架与 OpenVINO GenAI 的集成,OpenVINO GenAI 代码现在还支持在 NPU 上进行推测解码,以获得更好的性能,以及各种其他改进。

OpenVINO 2026.0 版本还通过提供与 NPU 插件的编译器集成,增强了 Intel Core Ultra NPU 的支持,以支持提前编译和设备上编译,而无需依赖 OEM 驱动程序更新。英特尔在此处的目标是为用户提供“一个单一的、准备就绪的发货包,减少集成摩擦并加速价值实现。”

通过 GitHub 下载 OpenVINO 2026.0 版本,并获取更多详细信息。我很快将发布新的 OpenVINO 基准测试和 OpenVINO GenAI 基准测试。

Linuxeden开源社区

Linuxeden开源社区